Was können Forschende tun, um Falschinformationen und Wissenschaftsleugnung effektiv zu entkräften? Psychologe Philipp Schmid identifiziert vier Problembereiche als apokalyptische Reiter des postfaktischen Zeitalters und beschreibt einen systematischen Ansatz für die Wissenschaftskommunikation, um damit umzugehen.

Postfaktische Apokalypse? – Vier Strategien gegen Wissenschaftsleugnung

Wissenschaftskommunikation könnte so einfach sein. Eine Wissenschaftlerin oder ein Wissenschaftler verkündet: „Impfen ist sicher!“, die Öffentlichkeit empfängt die frohe Botschaft und steigert als Reaktion die eigene Impfbereitschaft. Der Alltag sieht jedoch anders aus. Wissenschaftlerinnen und Wissenschaftler sehen sich im sogenannten postfaktischen Zeitalter vier apokalyptischen Reitern gegenüber, die jegliche Wissenschaftskommunikation zu torpedieren scheinen. Der erste apokalyptische Reiter, der Wissenschaftsleugner, generiert Falschinformationen ohne Unterlass. Der zweite Reiter, die Medien, multiplizieren nach Belieben die Reichweite dieser Falschinformationen. Der dritte Reiter, die Korrekturbotschaft der Wissenschaftlerinnen und Wissenschaftler, entpuppt sich als ineffektiv oder verstärkt die Falschinformation sogar. Und der vierte Reiter, die menschliche Informationsverarbeitung, macht den Empfänger der Falschinformationen blind für eine faktenbasierte Sichtweise. Um in diesem postfaktischen Szenario einen angemessenen Durchblick zu behalten, können Wissenschaftlerinnen und Wissenschaftler auf eine ihrer Kernfähigkeiten zurückgreifen – analytisches Denken. Wenn wir das Schreckensszenario des postfaktischen Zeitalters in Problemfelder gliedern, dann können wir die Reiter entmystifizieren, sie verstehen lernen und ihnen einen nach dem anderen entgegentreten.

Der erste Reiter: Science Denialism

Wissenschaftsleugnung (science denialism) ist eine Form der Pseudowissenschaft, die wissenschaftliche, konsensgestützte Erkenntnisse ablehnt1. Wissenschaftsleugner leugnen beispielsweise die Effektivität und Sicherheit von Impfungen, den menschengemachten Klimawandel (climate change denialism2), eine Verbindung zwischen HIV und AIDS (aids denialism3) oder die krebsfördernde Wirkung von Tabakkonsum (tobacco disease denialism4). Die Motive für diese irrationalen Überzeugungen reichen von finanziellen Interessen über persönlichen und sozialen Identitätsausdruck zu Angst und Phobien5. So verdienen beispielsweise einige Impfgegner durch den Verkauf von Büchern und der Bewerbung von Alternativprodukten schlicht Geld. Andere bewahren durch ihre non-konforme Haltung ihr bevorzugtes Selbstbild als die Person, die immer „einen Schritt weiterdenkt“ als alle anderen. Wiederum andere erlangen Akzeptanz und Bewunderung innerhalb ihrer sozialen Gruppe und nicht selten würde das Aufgeben der irrationalen Überzeugungen bedeuten, dass man eventuell auch den Kontakt zu Freunden und Familie verliert. Aber es wird auch die Sinnhaftigkeit der Verabreichung einer Impfung selbst infrage gestellt, um der eigenen Angst vor Nadeln aus dem Weg gehen zu können. Die Anzahl überzeugter Wissenschaftsleugner in der Bevölkerung gilt als überschaubar6. Dennoch verwendet diese kleine Gruppe Botschaften, die bei einer breiten Öffentlichkeit zu Verunsicherung führen können7.

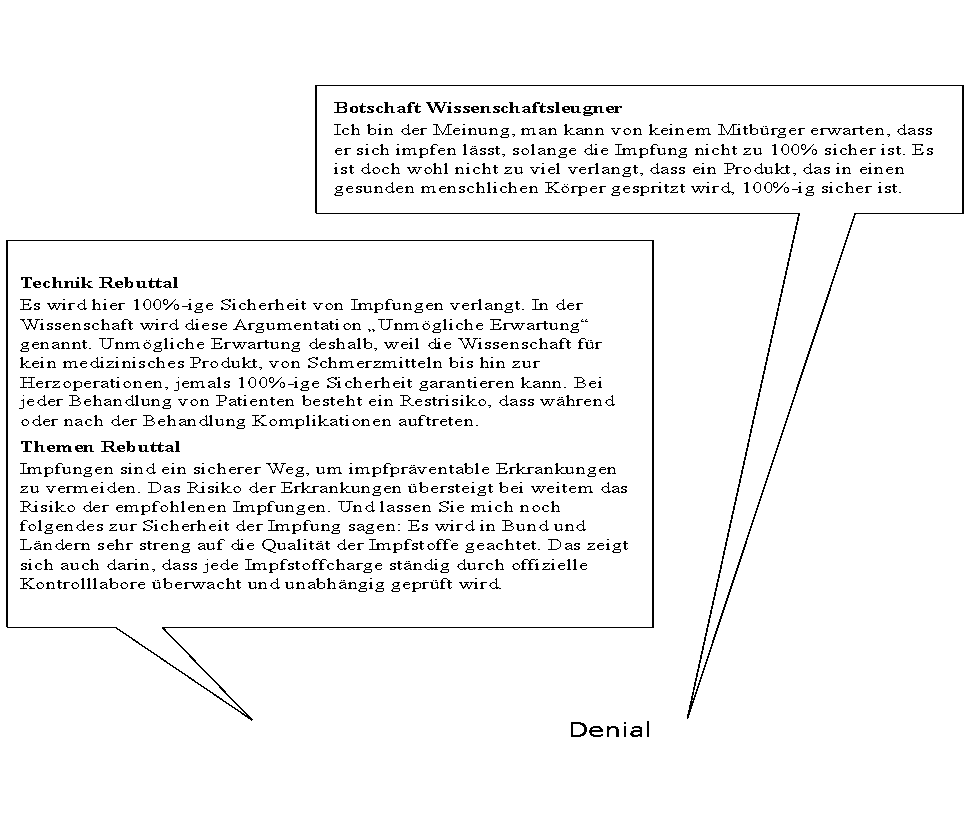

Die Botschaften basieren dabei oft auf den gleichen fünf rhetorischen Techniken8: Falsche Experten zitieren, Verschwörungstheorien postulieren, nicht-repräsentative Befunde selektieren, Fakten und Zitate verfälschen und unmögliche Erwartungen an die Wissenschaft stellen. So nutzen Impfgegner zum Beispiel oft die Technik der unmöglichen Erwartung und verlangen, dass eine Impfung zu 100 Prozent sicher sein soll. Dabei gilt: Kein medizinisches Produkt, von Schmerzmitteln bis hin zur Herzoperation, ist jemals 100 Prozent sicher. Doch Botschaften allein erreichen noch keine Massen. Es braucht Kanäle, um Falschinformationen der Öffentlichkeit zugänglich zu machen.

Der zweite Reiter: Die Medien

Schon früh konnte festgestellt werden, dass das Internet als Medium viele Tücken für Informationssuchende bereithält. In einer Studie aus dem Jahre 2002 konnten Davies, Chapman und Leask zeigen, dass bei Eingabe der Suchbegriffe Impfung und Immunisierung in sieben Suchmaschinen 43 Prozent der Treffer von Impfgegnern gestellt wurden9. Die Wahrscheinlichkeit, auf korrekte oder verzerrte Information zu stoßen, gleicht damit beinahe einem Münzwurf. Auch wenn sich das Verhältnis zwischen Fakten und Falschinformationen auf klassischen Internetpräsenzen vorteilhaft entwickelt hat, sind nun die sozialen Medien von einem ähnlichen Phänomen belastet – Falschinformationen verbreiten sich dort schneller als Fakten10. Doch auch die klassischen Medienkanäle haben ihre Tücken. Ein Beispiel ist die sogenannte falsche Balance (false balance)11. Falsche Balance beschreibt den Umstand, dass Wissenschaftlerinnen und Wissenschaftler sowie Wissenschaftsleugnerinnen und Wissenschaftsleugner in Medien oft wie gleichwertige Kontrahenten dargestellt werden. Das weckt beim Publikum fälschlicherweise den Eindruck, dass die unterschiedlichen Positionen durch ein gleiches Maß an Evidenz gestützt seien. Das Resultat: Falschinformationen werden eher geglaubt12.

Doch Science Denialism und Medien allein haben es schwer, gegen die schier überwältigende wissenschaftliche Faktenlage – oder?

Der dritte Reiter: Die Faktenbotschaft

Immer wieder hört man, dass Fakten allein noch keine effektiven Botschaften ausmachen. Doch damit nicht genug: Viele Kommunikatoren sind verunsichert, ob sie überhaupt versuchen sollen, Falschinformationen zu korrigieren, denn die sogenannten Backfire-Effects zeigen, dass Korrekturen die Falschinformation selbst sogar noch verstärken können13. Begründet werden diese Effekte zum Beispiel durch den Umstand, dass Wissenschaftlerinnen und Wissenschaftler die Falschinformation oft in den Korrekturen wiederholen. Wiederholungen in Korrekturen sollen wiederum die Vertrautheit mit der Falschinformation erhöhen und so ungewollter Weise dazu führen, dass Menschen diese eher für wahr halten14. Im Jahr 2011 wurde beispielsweise nach einem Kolibakterien-Ausbruch (EHEC) unter anderem die Salatgurke als möglicher Überträger des Erregers verdächtigt. Dieser Verdacht bestätigte sich später nicht und die Medien bemühten sich um Richtigstellung. Nach dem Prinzip der Backfire-Effekte waren Korrektur-Botschaften wie „EHEC: Es war nicht die Gurke“ jedoch potenziell schädlich, weil Menschen dazu neigen, die Verneinung auf lange Sicht zu vergessen. Was also bleibt in den Köpfen zurück? Die Begriffe „EHEC“ und „Gurke“ und ein Gefühl von Vertrautheit, das uns Menschen in die Irre führt.

Doch Science Denialism, Medien und Backfire-Effekte allein machen keinen Schaden. Am Ende entscheidet schließlich die Empfängerinnen und Empfänger der Botschaft was sie denken möchten.

Der vierte Reiter: Die Empfängerinnen und Empfänger

Nach einer Studie von Betsch et al. reichen 5 bis 10 Minuten auf Internetseiten von Impfgegnern, um die Risikowahrnehmung für Impfungen zu erhöhen und die Impfbereitschaft zu senken15. Menschen sind anfällig für die oft emotionalen Erzählungen von Einzelfällen, die auf den Seiten der Wissenschaftsleugnerinnen und Wissenschaftleugnern dargeboten werden. Doch nicht nur das: Menschen berücksichtigen Einzelfälle in Ihren Risikoeinschätzungen sogar, wenn man ihnen vorab die korrekten statistischen Informationen über das tatsächliche Risiko von Impfnebenwirkungen vorlegt16.

Diese sogenannte narrative Verzerrung (narrative bias) ist nur ein Beispiel aus einer Reihe von kognitiven Verzerrungen, die die menschliche systematisch-fehlerhafte Informationsverarbeitung dokumentieren17.

Wenn Science Denialism, Medien, Backfire-Effekte und kognitive Verzerrungen zusammenfallen, dann sind die Voraussetzungen für ein postfaktisches Zeitalter nahezu optimal. Ein Zeitalter, das Wissenschaftlerinnen und Wissenschaftler aber auch motiviert, innovativ zu werden.

Dem vierten Reiter entgegentreten: Die psychologische Impfung

Menschen sind Falschinformationen nicht schutzlos ausgeliefert. Nach der sogenannten Inoculation-Theorie18 können Individuen besonders dann adäquat auf Argumente von Wissenschaftsleugnerinnen und Wissenschaftsleugnern reagieren, wenn sie sich vorab der Bedrohung durch diese Argumente gewahr werden (threat induction) und wenn sie lernen, Gegenargumente zu formulieren (refutational preemption). Das Resultat: Ein psychologischer Präventionsschutz. Im Sinne dieser Theorie wurde von Roozenbeek und van der Linden ein Browser-Spiel entwickelt, das die Spielenden in die Rolle der Wissenschaftsleugnerinnen und Wissenschaftsleugner versetzt19. Durch diesen Perspektivwechsel werden sie sich über die Gefahr von Falschinformationen bewusst und erlernen spielerisch, mit welchen Mitteln Science Denialism im Internet manipuliert. Studien zeigen, dass Individuen nach dem Spiel besser in der Lage sind, Falschinformationen zu identifizieren und von diesen auch weniger beeinflusst werden20, 21 . Auch für Falschinformation rund um COVID-19 gibt es bereits eine Adaption dieser spielerischen Intervention. Probieren Sie es aus und immunisieren Sie sich noch heute.

Dem dritten Reiter entgegentreten: #Debunking2020

Seitdem die ersten Studien zu Backfire-Effekten publiziert wurden, folgten vermehrt Versuche, die Resultate zu replizieren. Eine Reihe von Folgestudien fand jedoch keine konsistente Evidenz für systematische Backfire-Effekte22. Wegen dieser neuen Befundlage wird in jedem Fall davon abgeraten, aus Furcht vor Backfire-Effekten von Korrekturen abzusehen23. Im Gegenteil: Korrigieren Sie, soviel es geht! Wie und wann man effektiv korrigiert, kann im neuen Debunking-Handbook 2020 im Detail nachgelesen werden. Das Handbuch gibt den aktuellen Wissensstand des Jahres 2020 zur Korrektur von Falschinformationen wieder und ist mit praktischen Anleitungen und theoretischem Hintergrundwissen für alle Anwenderinnen und Anwender von Wissenschaftskommunikation gedacht. Für alle Interessierten steht das Handbuch kostenlos zum Download zur Verfügung, neuerdings sogar in deutscher Sprache.

Dem zweiten Reiter entgegentreten: Gewichtete Berichterstattung

Anstelle von falscher Balance können Journalistinnen und Journalisten auf das sogenannte weight-of-evidence reporting24 zurückgreifen. Diese Art der Berichterstattung gewichtet die Positionen so, dass die aktuelle Evidenzlage widergespiegelt wird. Gewichten können Medienschaffende zum Beispiel über die Anzahl der Interviewpartnerinnen und Interviewpartner, die in einer Talkshow die jeweilige Position vertreten. Eine andere Möglichkeit der Gewichtung besteht darin, das Publikum vorab über eine mögliche verzerrte Darstellung zu informieren. Eine Studie unserer Forschungsgruppe zu diesem Thema zeigt allerdings keine Evidenz für die Wirksamkeit der Anzahl der Interviewpartnerinnen und Interviewpartner25. Allerdings zeigt die Studie auch, dass die Vorwarnung über falsche Balance den Einfluss der Wissenschaftsleugnerinnen und Wissenschaftsleugnern in der Öffentlichkeit mindern kann. Solche Vorwarnungen lassen sich ohne viel Aufwand oder Kosten in Medienbibliotheken oder direkt ins Gespräch integrieren. Ein Beispiel einer solchen Warnung findet sich in der frei zugänglichen Publikation unserer Studie.

Dem ersten Reiter entgegentreten: Rebuttal

Die Botschaften von Wissenschaftsleugnerinnen und Wissenschaftsleugnern erreichen vor allem in öffentlichen Diskussionen ein breites Publikum. Es ist der viel-geteilte Kommentar in den sozialen Medien, der Talk-Show-Beitrag im TV-Programm oder die Debatte am Elternabend, die der Außenseiterposition eine Bühne bietet und die Verbreitung von Falschinformationen ermöglicht. Doch wie begegnet man Science Denialism in einer öffentlichen Debatte? Hier besteht von Wissenschaftlerinnen und Wissenschaftlern oft der gut gemeinte Wunsch, die Wissenschaftsleugnerin oder den Wissenschaftsleugner selbst überzeugen zu wollen. Dieses Vorhaben ist in der Regel allerdings zum Scheitern verurteilt. Die dargelegten Motive (siehe Abschnitt Der erste Reiter: Science Denialism) immunisieren die Betroffenen oft gegen das Überdenken der eigenen Weltvorstellungen. Vor allem in öffentlichen Debatten, wenn also andere zusehen oder zuhören, werden sie sich üblicherweise nicht überzeugen lassen. Eine wesentliche Regel im Umgang mit Science Denialism in öffentlichen Debatten lautet also: Die Kernbotschaft der Wissenschaftskommunikation soll nicht die Wissenschaftsleugnerinnen oder den Wissenschaftsleugner überzeugen, sondern so gestaltet werden, dass die Öffentlichkeit vor Falschinformationen geschützt wird26. Doch die Möglichkeiten der Botschaftsgestaltung sind bei Science Denialism beinahe unendlich. Wie kann man da sinnvolle Gegenargumente vorbereiten ( rebuttal)? Obwohl die Möglichkeiten beinahe unendlich scheinen, nutzen Wissenschaftsleugnerinnen und Wissenschaftsleugner oft die gleichen fünf bekannten rhetorischen Techniken: Falsche Expertinnen und Experten zitieren, Verschwörungstheorien postulieren, nicht-repräsentative Befunde selektieren, Fakten und Zitate verfälschen und unmögliche Erwartungen an die Wissenschaft stellen27. Studien unserer Forschergruppe zeigen: Diese Techniken zu demaskieren und aufzuzeigen, was an Ihnen fehlerhaft ist, kann den Effekt von Science Denialism erfolgreich reduzieren28, 29. Es reicht für eine gute Vorbereitung also oft, eine Antwort auf die fünf Techniken parat zu haben (siehe Beispiel). Wenn Sie allerding über Faktenwissen im jeweiligen Bereich verfügen (etwa Impfen, Klimawandel), dann wirkt das Richtigstellen mit Hilfe der Fakten in öffentlichen Debatten ähnlich effektiv wie die Demaskierung der Rhetorik.

Ein Beispiel

Impfgegnerinnen und Impfgegner leugnen zum Beispiel oft die Effektivität von Impfungen, die Sicherheit von Impfungen, die Vertrauenswürdigkeit von Expertinnen und Experten oder die Gefahr von Krankheiten, gegen die man impfen könnte. Zudem thematisieren Sie oft angebliche Alternativen zum Impfen. Als Vorbereitung ist es also ebenfalls ausreichend, eine Antwort auf die fünf Themen parat zu haben (siehe Abbildung) – ein Problem, zwei Lösungswege. Beide Vorgehensweisen sind wirksam und reduzieren den Vorbereitungsaufwand für Wissenschaftlerinnen und Wissenschaftler enorm.

Weitere konkrete Beispiele und ergänzende Details dazu, wie effektives Rebuttal funktioniert, können im Dokument der Weltgesundheitsorganisation „How to respond to vocal vaccien deniers in public“ nachgelesen werden. Das Dokument steht frei zur Verfügung.

Wissenschaftskommunikation könnte so einfach sein. Eine Wissenschaftlerin oder ein Wissenschaftler verkündet „Impfen ist effektiv!“, die Öffentlichkeit empfängt die frohe Botschaft und steigert als Reaktion die eigene Impfbereitschaft. Die Realität sieht zum Glück anders aus. Menschen sind in der Regel keine Fähnchen im Wind, sondern zur Skepsis fähige Individuen. Psychologische Impfungen, effektives Debunking und Rebuttal bedienen diese Skepsis, denn diese Methoden wollen nicht überreden, sondern überzeugen. Und auch wenn die geplante Einführung einer neuen COVID-19 Impfung bereits erahnen lässt, dass alle vier apokalyptischen Reiter bald wieder zur Höchstform auflaufen werden, so zeigen die neuen Innovationen, dass der Wissenschaftskommunikation noch lange nicht nach Endzeitstimmung zumute ist. Im Gegenteil: Wissenschaftskommunikation entfaltet im Angesicht der postfaktischen Reiter ihr ganzes Potential.

Gastbeiträge spiegeln nicht zwangsläufig die Meinung der Redaktion wider.

- Hansson, S. O. Science denial as a form of pseudoscience. Stud. Hist. Philos. Sci. Part A 63, 39–47 (2017). ↩︎

- Dunlap, R. E. Climate Change Skepticism and Denial: An Introduction. Am. Behav. Sci. 57, 691–698 (2013). ↩︎

- Kalichman, S. C. The psychology of AIDS denialism: Pseudoscience, conspiracy thinking, and medical mistrust. Eur. Psychol. 19, 13–22 (2014). ↩︎

- Proctor, R. N. Golden holocaust: Origins of the cigarette catastrophe and the case for abolition. Golden Holocaust: Origins of the Cigarette Catastrophe and the Case for Abolition (University of California Press, 2012). doi:10.1136/medhum-2012-010202 ↩︎

- Hornsey, M. J. & Fielding, K. S. Attitude roots and jiu jitsu persuasion: Understanding and overcoming the motivated rejection of science. Am. Psychol. 72, 459–473 (2017). ↩︎

- Lewandowsky, S., Pilditch, T. D., Madsen, J. K., Oreskes, N. & Risbey, J. S. Influence and seepage: An evidence-resistant minority can affect public opinion and scientific belief formation. Cognition 188, (2019). ↩︎

- Schmid, P. & Betsch, C. Effective strategies for rebutting science denialism in public discussions. Nature Human Behaviour (2019). doi:10.1038/s41562-019-0632-4 ↩︎

- Diethelm, P. & McKee, M. Denialism: What is it and how should scientists respond? European Journal of Public Health 19, 2–4 (2009). ↩︎

- Davies, P., Chapman, S. & Leask, J. Antivaccination activists on the world wide web. Arch. Dis. Child. (2002). doi:10.1136/adc.87.1.22 ↩︎

- Vosoughi, S., Roy, D. & Aral, S. The spread of true and false news online. Science (80-. ). 359, 1146–1151 (2018). ↩︎

- Kohl, P. A. et al. The influence of weight-of-evidence strategies on audience perceptions of (un)certainty when media cover contested science. Public Underst. Sci. 25, 976–991 (2016). ↩︎

- Dixon, G. N. & Clarke, C. E. Heightening Uncertainty Around Certain Science: Media Coverage, False Balance, and the Autism-Vaccine Controversy. Sci. Commun. 35, 358–382 (2013). ↩︎

- Lewandowsky, S., Ecker, U. K. H., Seifert, C. M., Schwarz, N. & Cook, J. Misinformation and Its Correction: Continued Influence and Successful Debiasing. Psychol. Sci. Public Interes. Suppl. 13, 106–131 (2012). ↩︎

- Swire, B., Ecker, U. K. H. & Lewandowsky, S. The role of familiarity in correcting inaccurate information. J. Exp. Psychol. Learn. Mem. Cogn. 43, 1948–1961 (2017). ↩︎

- Betsch, C., Renkewitz, F., Betsch, T. & Ulshöfer, C. The influence of vaccine-critical websites on perceiving vaccination risks. J. Health Psychol. (2010). doi:10.1177/1359105309353647 ↩︎

- Betsch, C., Haase, N., Renkewitz, F. & Schmid, P. The narrative bias revisited: What drives the biasing influence of narrative information on risk perceptions? Judgm. Decis. Mak. 10, 241–264 (2015). ↩︎